随着人工智能(AI)变得越来越重要的方面我们的生活,我们现在才开始了解它可能解释我们周围的世界。一项新的研究由麻省理工学院(MIT)发现了AI能比人类更严厉的评判规则是否有被打破。万博体育登录首页

人工智能的风险采取行动基于解释的违反

根据这个故事MSN,研究人员警告说,这可能会导致AI超越时的惩罚取决于信息编程了。

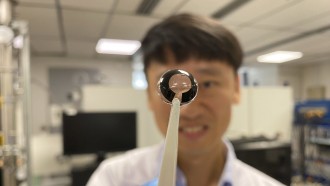

这项研究观察了AI将如何解释认为违反一个代码,特别是使用狗图片的例子可能违反房屋租赁政策反对激进的品种。

参与者被分成两组;描述性的团队被要求表明是否提出了三个事实特征在图像或文本,比如狗是否出现攻击性。

人类偏见的风险增加时,利用人工智能策略设置

相比之下,规范集团信息包罗万象的狗政策,负责图像是否违反了它,为什么。描述性的研究发现,团队是20%更有可能违反比规范声明一个代码,显示使用的数据可以显著影响的结果。

这有着重要的意义,因为使用这种类型的数据在政策环境可能导致更严厉的惩罚,如长句子或更高的保释金额由人类——比决定。

避免人类偏见被AI展出的风险,研究人员认为需要更多的数据透明度和数据用于匹配目的上下文。如果使用人工智能在人类的过程,如法律和医学设置,然后是很重要的,专家在这些字段用于数据输入。

需要透明度和人力监督在人工智能决策

这将确保AI可以更有效地解释的细微差别,并取得更大的成果。这项研究揭示了程序被透明的有关数据的重要性已经被用于火车AI这可以被认为是潜在的偏见。

与人工智能成为越来越普遍在我们的生活中,它是必不可少的,进行进一步的研究,以确保它不是滥用,人类的判断是在必要时考虑。

读也:麻省理工学院的新的人工智能万博体育登录首页技术能使x射线愿景成为现实!这是对车辆有什么好处

了解人工智能以及如何减轻它们的风险

来解决这个问题,麻省理工学院的专家呼吁更大的透明度在数据收集,并指出知道如何收集和使用数据可以帮助防止人工智能模型过于严厉。另一篇文章,表股票风险的人工智能。

需要更多的意识对使用人工智能决策的含义和使用规范数据描述性数据的重要性。的国家标准与技术研究院万博体育登录首页还发表了一个AI风险管理框架与私人和公共部门合作。

相关文章:OpenAI CEO Sam Altman解决迫切需要人工智能监管美国参议院